深入解析硬件加速技术:驱动现代计算效率飞跃的核心引擎

- 问答

- 2025-11-05 10:56:46

- 9

在当今这个信息爆炸的时代,我们几乎每时每刻都在与计算技术打交道,从流畅播放的超高清视频到瞬间响应的人工智能对话,再到宏大逼真的虚拟游戏世界,支撑这些体验的,并非仅仅是CPU(中央处理器)主频的简单提升,而是一场静默却深刻的效率革命,其核心引擎正是“硬件加速”技术,硬件加速就是为特定的、繁重的计算任务量身定制专门的硬件电路,让“专业的人做专业的事”,从而极大地提升效率、降低功耗。

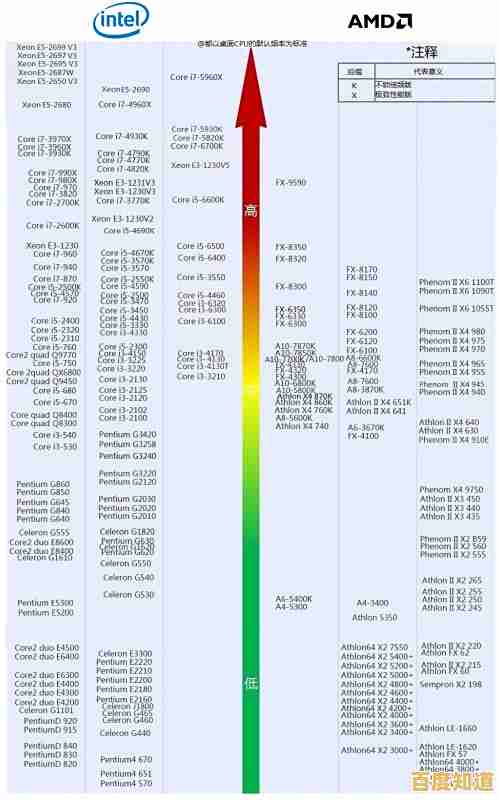

要理解硬件加速为何如此重要,我们可以从一个生动的比喻开始,想象一下,CPU就像一位无所不能的大学教授,他知识渊博,能解复杂的数学题,能写文章,也能处理行政事务,但当需要大规模搬运图书(数据处理)或者同时给几百人分发资料(并行计算)时,这位教授就会显得力不从心,效率低下且疲惫不堪,如果我们请来专业的图书管理员(例如GPU,图形处理器)和一群训练有素的助手(例如TPU,张量处理器),他们各司其职,专门负责自己最擅长的领域,整个工作的效率就会得到成千上万倍的提升,这就是硬件加速的基本思想。

硬件加速并非一个新概念,其最成功和最早普及的案例就是GPU,最初,GPU是专门为处理计算机图形显示而设计的,根据《计算机体系结构:量化研究方法》中的观点,图形渲染涉及大量并行、简单的数学计算(如顶点变换、像素着色),这与CPU擅长的复杂、串行逻辑控制截然不同,专门为并行计算优化的GPU应运而生,它拥有成千上万个简单的计算核心,能同时处理海量数据,正是GPU的出现,才使得实时3D游戏、计算机辅助设计等应用成为可能。

真正的转折点在于,人们发现GPU的这种大规模并行计算能力并不仅限于画图,21世纪初,研究人员开始利用GPU来加速科学计算,这后来演变为GPGPU(通用图形处理器)技术,这一发现如同打开了潘多拉魔盒,预示着专用硬件加速时代的到来,斯坦福大学的研究报告指出,在某些科学计算任务上,GPU相比CPU可以实现数十倍甚至上百倍的性能提升和能耗降低。

进入人工智能时代,特别是深度学习爆发后,硬件加速的需求达到了前所未有的高度,深度学习模型的训练和推理涉及海量矩阵乘法和卷积运算,这恰好是GPU的强项,GPU成为了训练大型AI模型的首选硬件,几乎垄断了早期市场,但科技巨头们并不满足于此,他们开始设计更为极致的专用芯片,谷歌推出了TPU,它完全针对神经网络的核心运算(张量处理)进行定制化设计,剔除了GPU中与图形处理相关的冗余单元,从而在AI计算上实现了更高的效率和更低的功耗,根据谷歌在相关学术论文中披露的数据,TPU在推理任务上的性能功耗比远超同期的CPU和GPU。

这种“专用化”的趋势正在席卷整个计算领域,苹果公司在其M系列芯片中集成了强大的神经网络引擎,专门用于加速手机和电脑上的AI应用,如人脸识别、照片处理等,使得这些功能能够实时、低功耗地运行,在数据中心,亚马逊AWS等云服务商也推出了各种功能的专用加速器,比如专门用于视频编码的芯片,能将视频转码效率提升数倍,大大降低了流媒体服务的成本。

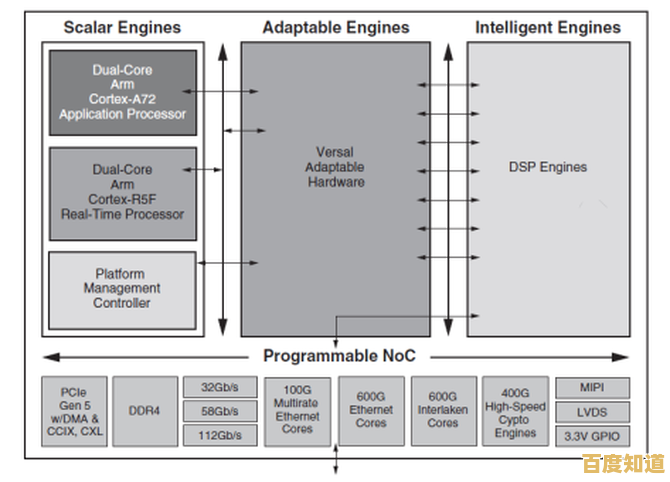

硬件加速技术正驱动着现代计算效率的飞跃,其影响是深远的,它打破了过去几十年依赖通用CPU性能线性提升的“摩尔定律”瓶颈,通过架构创新开辟了新的赛道,这带来了一种新的计算范式:异构计算,在这种范式下,系统不再依赖于一个强大的通用核心,而是由一个指挥中心(CPU)协同多个功能各异的加速器(GPU、TPU、NPU等)共同工作,形成一个高效的“计算团队”。

展望未来,硬件加速的专用化程度只会越来越高,随着5G、物联网、自动驾驶、元宇宙等技术的发展,将会涌现出更多样化的计算负载,可以预见,将会出现专门用于处理自动驾驶感知数据的芯片、专门用于虚拟现实渲染的芯片,甚至为特定算法定制的芯片,硬件加速技术,这台驱动现代计算效率飞跃的核心引擎,将继续以其精准而强大的动力,塑造着我们未来的数字生活,让曾经看似不可能的实时交互和智能应用成为触手可及的日常。

本文由汪微婉于2025-11-05发表在笙亿网络策划,如有疑问,请联系我们。

本文链接:http://jiangsu.xlisi.cn/wenda/71965.html